type

Post

status

Published

date

Mar 31, 2026

slug

mem0-source-code-analysis-1

summary

AI Agent 最大的痛点是什么?它会「失忆」。本文从短期记忆与长期记忆的区别入手,解释了为什么 LLM 天生无状态,以及 Mem0 作为开源长期记忆框架如何解决跨会话记忆问题。作为 50K+ Star 的项目,Mem0 几乎已成为 AI Agent 记忆的事实标准。本文是 Mem0 源码解析系列的开篇,后续将深入探讨记忆的添加与搜索机制。

tags

agent

长期记忆

Mem0

category

agent

icon

password

AI Agent 最大的痛点:它会「失忆」

你有没有经历过这样的场景:

和 AI 助手聊了半小时,告诉它你的工作背景、技术栈、项目细节。 第二天再打开对话,它又问:「请问你是做什么的?」

这不是个例,而是 所有 AI Agent 的通病。

为什么会这样?

LLM(大语言模型)天生是无状态的:

- 每次对话都是全新的开始

- 上下文窗口有限(即使 1M 也会用完)

- 无法跨会话保留信息

这对 AI Agent 来说是致命的:

短期记忆 vs 长期记忆

要理解 Mem0 解决的问题,先要区分两种记忆:

短期记忆(Short-term Memory)

定义:当前会话内暂时保存的上下文信息。

特点:

- 会话结束即消失

- 依赖 LLM 的上下文窗口(容量有限)

- 根据使用场景通常取 30-50 轮对话或 整个session上下文

- 无需额外存储

典型场景:

局限性:

- 新会话 = 从零开始

- 对话太长会「遗忘」早期内容

- 无法跨天、跨设备使用

长期记忆(Long-term Memory)

定义:持久化存储的关键信息,跨会话可用。

特点:

- 永久保存(除非主动删除)

- 独立于 LLM 上下文窗口 (容量理论上无限)

- 需要外部存储(向量数据库)

典型场景:

对比总结

维度 | 短期记忆 | 长期记忆 |

生命周期 | 会话期间 | 永久保存 |

存储位置 | LLM 上下文窗口 | 向量数据库 |

容量 | 有限(几十轮对话) | 理论无限 |

检索方式 | 顺序读取 | 语义搜索 |

跨会话 | ❌ 不支持 | ✓ 支持 |

实现成本 | 零成本 | 需要存储基础设施 |

短期记忆是「临时便签」,长期记忆是「永久笔记本」。

为什么是 Mem0?

Mem0(读作 mem-zero)是一个专为 AI Agent 设计的长期记忆框架。

在阿里云开发者的一篇公众号博文中,提到Mem0 作为一个开源的长期记忆框架,几乎成为事实标准。GitHub 50K+ Star数也是目前开源记忆框架最高的。当然这也是面试中常问的问题,因此有必要从Mem0入手,看看如今的agent memory到底是怎么工作的。

它解决的核心问题:

让 AI Agent 能够跨会话、跨时间记住用户信息,实现真正的个性化交互。

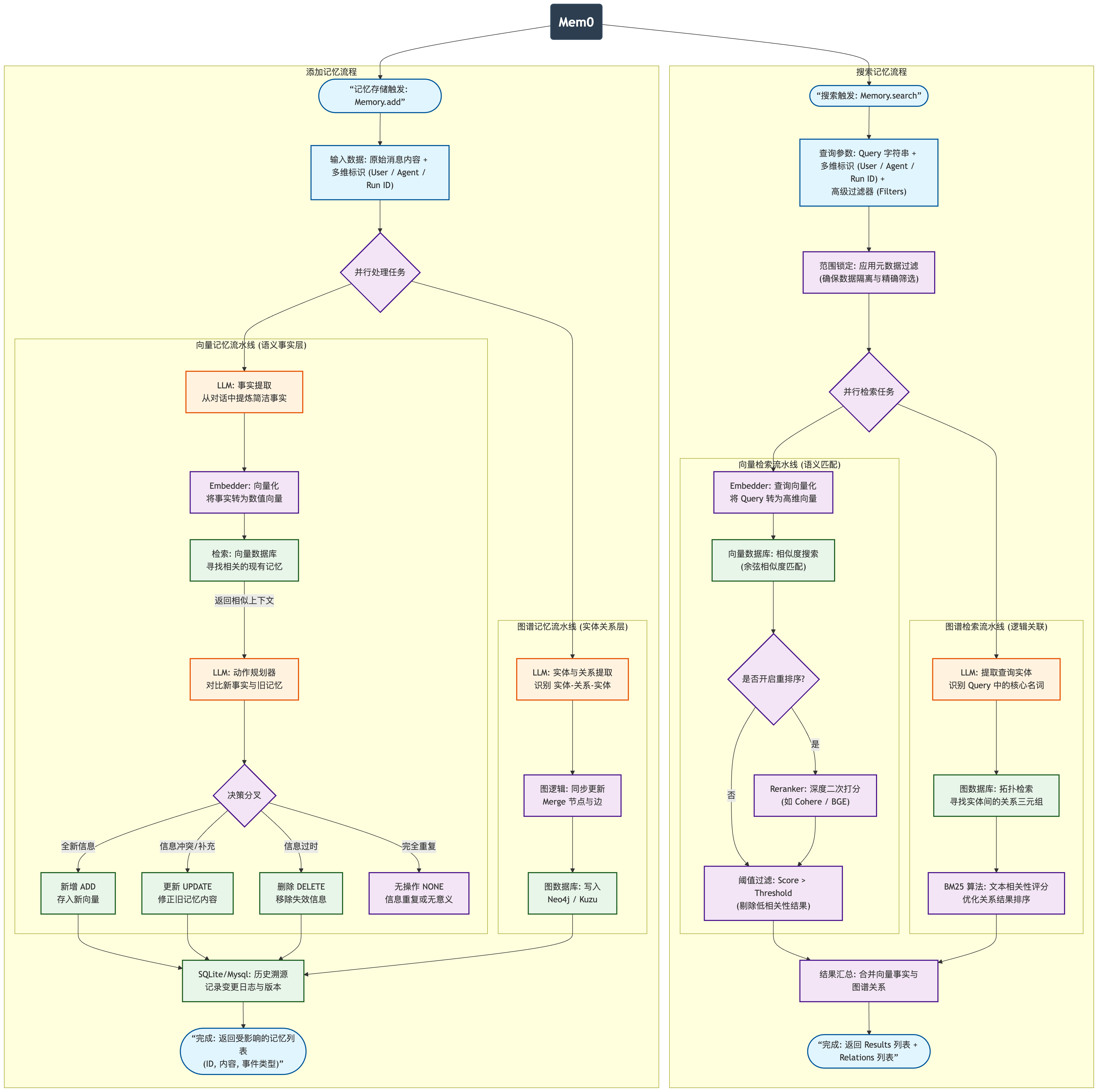

接下来,我将开启一系列的文章,深入 Mem0 源码,围绕记忆是如何添加的、如何搜索的这两大核心问题展开解析。

如果这篇内容对你有帮助,欢迎关注,后续更新不错过~

相关链接:

- GitHub:https://github.com/mem0ai/mem0

- AI Agent 记忆系统:从短期到长期的技术架构与实践:https://mp.weixin.qq.com/s/mftM6jr0YiFxRATeNvm5Qg